热点新闻

自动驾驶比人靠谱 12.5%,Waymo 整出了数学模型证明

![]() admin2022-10-08 05:41

190人已围观

admin2022-10-08 05:41

190人已围观

简介自动驾驶比人靠谱 12.5%,Waymo 整出了数学模型证明

自动驾驶老前辈 Waymo 发话:

我们的 AI 司机能够规避 75% 的碰撞事故发生,减少 93% 的严重受伤,统统高于理想状态下人类司机模型的 62.5% 和 84%。

等等,你发现问题没有?

如此精确的定量描述自动驾驶安全性,Waymo 的依据是什么?

Waymo 最新论文的目的,并不是炫耀自动驾驶有多安全,至少不全是。

AEB(主动刹车)成标配,智能汽车喊了很多年。

但各家水准不一,多少时速、什么样的障碍物下 AEB 或紧急避让生效,才算合格的产品?

Waymo 真正的目标是尝试制定一套规范,来定义和评价某个自动驾驶系统是否安全。

以后任何公司说自动驾驶比人类司机更安全,需要用科学的计算体系做支撑,而不是简单笼统的用不同条件下路测和事故情况作比较了。

评价的基准是什么:对人类反应时间进行建模

Waymo 的贡献之一在于,他们研究出了一种全新架构模型 —— 以此来对真实道路环境下的司机反应时间进行测量和建模。

其实简单地说,就是通过人类司机应对紧急情况的平均反应时间,来对比一个自动驾驶系统的反应时间。

这种架构,不仅适用于自动驾驶,还可用于其他交通安全领域。

具体来看,该模型基于两大核心观点得来:

第一,为了避免碰撞发生,司机往往会选择刹车或是打方向盘。他们做出这一举动,主要因为当前的交通状况与他们原先所想的不一样,即司机表现出了惊讶。

也就是说,反应时间取决于司机对当前交通状况的预判。惊讶和意外从何时开始,将会直接决定反应时间的长短。

第二,反应时间取决于动态变化的交通环境。并不存在一个放之四海而皆准的固定时间,可以适用于所有不同场景。

举例来说就是,如果你前面的车突然急刹,你就能迅速作出反应;相反,在其他条件都相同的情况下,如果前车缓慢减速,你的反应时间也会相应延长。

需要特别说明的是,这里的反应时间,专指司机决定是否要刹车或转弯的心理过程,不包括后续的规避动作(即打方向盘或踩刹车)。

下图可以更好地解释他们的模型架构。

整个过程概括起来就是认知的转变(belief updating process)。

图中上半部分,司机看到红绿灯后,自然而然产生的想法是前车要刹车减速,事实是前车的确刹车减速了。所以司机的预判是正确的,与事实结果相匹配,在这样的情况下,司机没有出现任何“惊讶”。

图中下半部分,司机原以为前车要继续前行,然而事实是前车突然刹车,这就与他的心理预期不相符合,认知也就出现了迭代更新。

下图可以更进一步解释认知转变的整个过程。

这一模型架构的出现,主要为了解决之前在反应时间建模上存在的两大局限:

1、反应时间过于依赖周围环境;

2、如何对“刺激因素”(stimulus)明确下定义。

Waymo 希望能测出在真实道路环境下,面对各种错综复杂的驾驶环境,人类从看到障碍物到踩下刹车的反应时间。

传统方法下,反应时间的分析一般是基于特定可控的实验,而且也不能对常见交通事故下的“刺激因素”何时触发明确下定义。

有了这样较为严谨的反应时间基准模型后,就可以对自动驾驶系统的表现进行评估了。

人类司机作为参考模型

为了评判 Waymo 他们自己的 AI 司机表现如何,除了上文提到的反应时间模型,还需要一个标准和参照物。

NIEON 应运而生。

它是一个行为参照模型(reference behavior model),是理想状态下的人类司机,名字来源于 Non-Impaired Eyes ON the conflict 这一串话中每个单词的首字母。

意思就是,NIEON 司机不存在智力或听力、视觉上的损伤,它在开车的时候全程保持专注,不会分心开小差,也不会疲劳犯困。

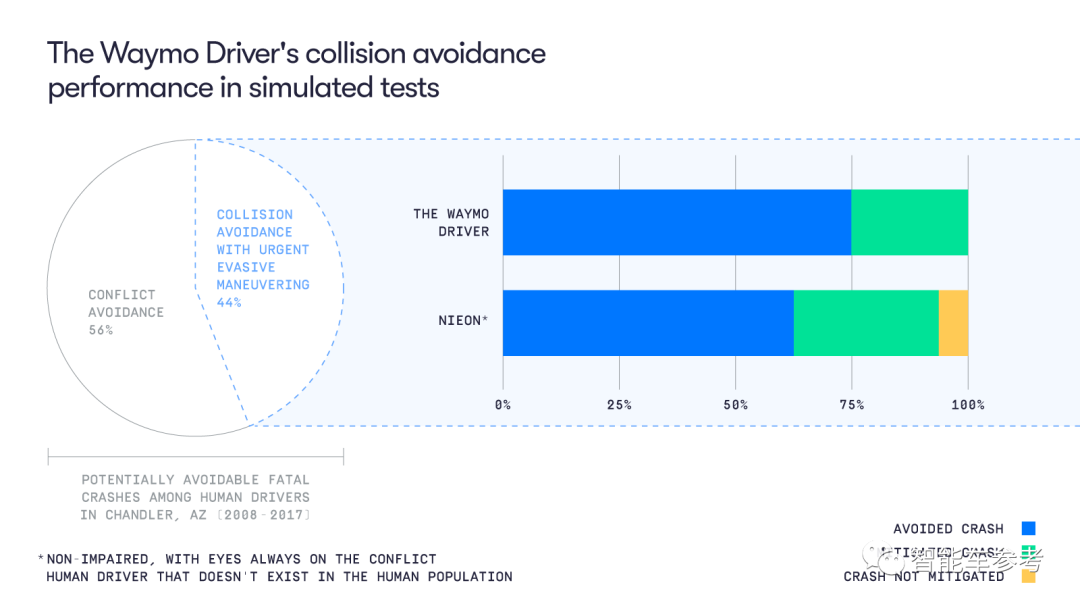

把 Waymo 他们的 AI 司机,与 NIEON 模型对比后,得出的结果是:

在防碰撞反应(collison avoidance effect)里,同时被卷入 16 起交通事故中,Waymo 的自动驾驶系统能够规避 12 起碰撞发生,即规避概率达到了 75%。

注:这里专指防碰撞反应,不包括防止事故发生反应(conflict avoidance effect),意思就是专指你改变轨迹、速度以避免事故的发生 / 减轻事故的严重性,又或是你失控后重新控制了车辆。

相比之下,理想状态下的 NIEON 模型,规避了 10 起碰撞发生,规避概率为 62.5%。

与此同时,Waymo 的自动驾驶系统,能够减轻 93% 因碰撞带来的人员重伤发生;NIEON 模型只能做到减轻 84%。

所以 Waymo 才得出了结论,说他们的自动驾驶 AI 司机比人类老司机更安全。

该论文表示,类似于 NIEON 的行为参考模型,能够被用来作为衡量基准,以此来评判一套 ADS 自动驾驶的好坏和安全性。

至于测试结果是否可靠,Waymo 官方也在论文中谈到了 4 点局限性。

首先,他们当前使用的数据集,涉及的碰撞事故主要由人引发。当然目前重要的是,要考虑清楚自动驾驶系统如何才能正确应对这些已知的、人类引发的碰撞事故,同时测试好这套系统的能力,以避免类似的行为发生。

其次,该研究仅基于警方报告的碰撞事故进行了模型重建,而官方文件中记录的碰撞事故数量,可能与真实情况存在出入。

第三,当前研究仅基于单个的 NIEON 模型操作,来评判 Waymo 他们自动驾驶系统的好坏。

第四,整个自动驾驶系统的表现,是在模拟的环境、不同的条件下进行测试的。如果是一些特定场景的挑战,从严格意义上来说不适用于这个方法。

不为炫耀数据,Waymo 这两篇文章有什么意义?

我们从一个最普遍的问题说起:为什么自动驾驶落地困难?

表面上看,是法规不完善,对于自动驾驶车辆权责的划分没有明确。

但我们不妨站在立法机构的角度考虑一下,为什么自动驾驶在如今的 L2-L3 阶段责任划分不明?

很简单,因为目前的自动驾驶系统还没有完善到“万无一失”,需要人类司机随时准备接管。

而这个接管的时机和条件,从来没有明确。

没有定性、定量的标准界定什么样的情况下人类需要接管系统,自然也就无法在法律上清晰地划分权责。

所以,法规不完善,根源不在立法的滞后性,而是整个自动驾驶行业,从来没有给立法机构提供过能在法理层面行得通的技术标准。

甚至行业通用 SAE 的 L0-L5 分级,也是基于对人类干预程度的感性描述,而不是科学严谨的定量描述。

要在法规层面扫清自动驾驶落地的障碍,需要在系统可靠性、道路复杂程度、系统能力边界、人类介入条件、系统失效临界点等等维度,都给出确切、严谨的定义。

Waymo 两篇论文,瞄准的正是自动驾驶系统可靠性这个维度,以反应时间为进准,来定量计算自动驾驶系统可靠性。

都说自动驾驶比人类司机可靠,到底有多可靠?

特斯拉以往的话术,是比较美国交管部门对非自动驾驶车辆的事故数量统计,和特斯拉事故数得出的。

但这其中的问题,首先是全美范围路况、车况、事故类型太复杂,远远超出自动驾驶数据库的场景覆盖。

一些人类无法避免的事故,不见得 FSD 就能避免,只有在相同条件下复现实验,才能下结论。

但这显然是不现实的。这也是特斯拉商业宣传的迷惑性所在。

而 Waymo 的模型和方法,不敢说一定会成为行业标准,但至少是为自动驾驶安全性界定,开了一个好头。

当然,Waymo 这两篇论文还有一层意义那就是再次向公众科普了自动驾驶不等于 0 事故。

即使是 L4、L5 这样的高阶自动驾驶系统,仍然有失效的风险。

自动驾驶的意义在于,系统犯错失效的风险比人类更低,就能极大推动社会经济运转效率。

这一点现在有了严谨的证明,也有了立法的依据。

好了,以上就是这两篇论文的亮点部分,如果你想阅读全文,这里也附上链接:

https://waymo.com/intl/zh-cn/safety/

本文来自微信公众号:智能车参考 (ID:AI4Auto),作者:邓思邈、贾浩楠

微信公众号

微信公众号

很赞哦!(0)

相关文章

文章评论

评论0

站点信息

- 微信公众号:扫描二维码,关注我们

点击排行

三种 PS 的套索工具使用小技巧

三种 PS 的套索工具使用小技巧

标签云

-

php

网页设计

个人博客

JS

个人博客

Html

春节必看: 2020新春红包大战 全攻略

新增详细玩法攻略!

支付宝集五福5亿集分宝招商银行抽现金券抖

抖音 2020 发财中国年 攻略

支付宝集五福5亿集分宝招商银行抽现金券抖

最近购买威尔胜WTB0900复刻版和WT

mysql慢查询和php-fpm慢日志

PSR-2

基础代码规范

Thinkphp

响应式

公司

整站

源码

网络科技网站模板

1024

节日

百度收录

论坛

社区

2020

豆瓣

评分最高

电影

debugger

调试

Python

语法

高德

百度地图

MySQL

追寻

webpack

vue

oracle

服务器搭建

有趣

动物

人体

历史

天文

生活

名人

体育

地理

文化

科学

心理

植物

饮食

自然

图片

JVM

IDEA

Loader

Git

UNIAPP

股票

A股

同花顺

海尔

海天味业

半年报

股市总结

歌尔股份

乐普医疗

涪陵榨菜

餐饮

财报分析

酒店

年报分析

美锦能源

山煤国际

贵州茅台

张坤

腾讯

华鲁恒升

淮北矿业

药明康德

早盘关注

国电电力

北方华创

宝丰能源

TCL中环

兔宝宝

天润乳业

启明星辰

阳光电源

山西汾酒

迈瑞医疗

人福医药

比亚迪

宁德时代

汤臣倍健

伊利股份

通威股份

东鹏饮料

隆基股份

紫金矿业

五粮液

康龙化成

赣锋锂业

爱尔眼科

片仔癀

VR

永新股份

爱美客

美的集团

格力电器

科沃斯

云南白药

同仁堂

洋河股份

白云山

三体

狂飙 原著